Lutter contre la désinformation à l’ère de l’IA

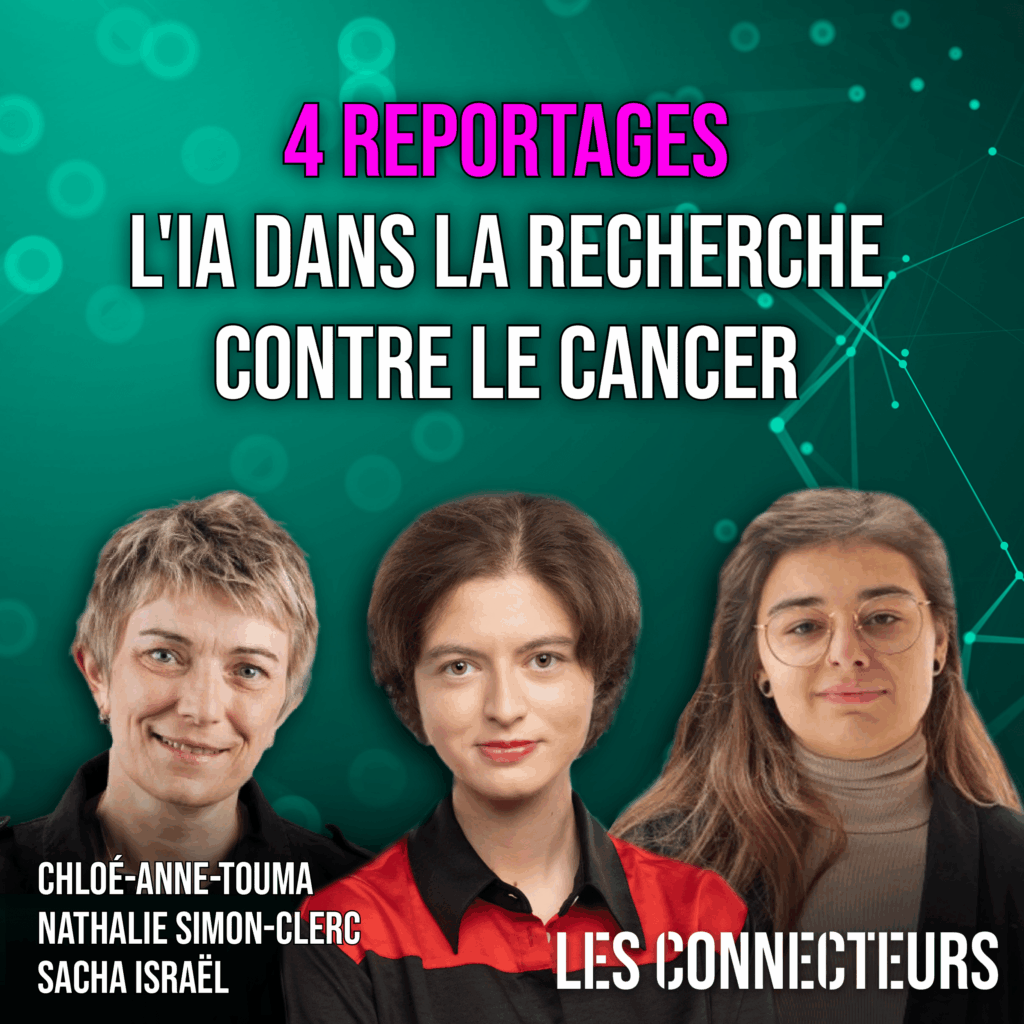

En 2023, seulement 40 % des Canadiens faisaient encore confiance aux médias. Ce chiffre s’inscrit dans un contexte où la désinformation se propage plus vite que jamais, portée par l’intelligence artificielle (IA) et les réseaux sociaux. La rédaction de LES CONNECTEURS a recueilli les témoignages de huit experts rencontrés par notre rédactrice en chef, Chloé-Anne Touma, lors de l’événement « Désinformation à l’ère de l’IA » organisé par le CRIM, faisant le point sur les défis actuels afin d’en dégager des solutions concrètes pour aider les citoyens et les institutions à mieux se protéger.

Un texte de Mérédith Campeau, soutenu par les entrevues menées par Chloé-Anne Touma

Les défis amplifiés par les nouvelles technologies

L’IA, outil de désinformation de masse

L’IA générative transforme radicalement la production de désinformation. Elle permet de créer, à faible coût et en quelques secondes, des textes, images, vidéos ou voix qui imitent parfaitement le réel. Cette accessibilité permet une diffusion massive de contenus trompeurs.

Parmi les usages, la synthèse vocale est particulièrement problématique. En seulement trois secondes d’enregistrement, une IA peut reproduire la voix d’une personne et lui faire dire n’importe quoi. « La parole, ça a toujours été utilisé pour faire de la désinformation (…) Mais là, ça atteint un autre niveau », souligne Gilles Boulianne, chercheur au CRIM. Cette technologie rend les fraudes vocales beaucoup plus difficiles à détecter, notamment dans des secteurs sensibles comme la finance ou les services publics.

« Un individu seul a accès à des systèmes puissants pour produire du contenu. »

Les manipulations visuelles suivent la même logique. Des images ou vidéos entièrement générées (deepfakes) ou simplement modifiées (cheapfakes) circulent massivement sur les réseaux. Martine Turenne, rédactrice en chef de La Conversation Canada, prévient que certaines fausses publicités ou interventions sont si réalistes qu’elles peuvent tromper même les professionnels les plus expérimentés.

Cette capacité de production massive change l’équilibre du pouvoir informationnel. « L’IA générative vient court-circuiter toute la chaîne d’intermédiaires », explique Mathieu Colin, professeur associé à l’Université de Sherbrooke. « Un individu seul a accès à des systèmes puissants pour produire du contenu. » Thierry Warin, professeur à HEC Montréal et chercheur principal au CIRANO, ajoute : « Une fois qu’un robot est codé, on peut en coder un million, voire cent millions. » Ce phénomène permet une diffusion beaucoup plus large des campagnes de désinformation.

Enfin, l’IA facilite la traduction automatisée de contenus. En quelques clics, des messages extrémistes ou radicaux peuvent franchir les barrières linguistiques et se répandre dans le monde entier, gagnant en visibilité et en impact. La désinformation devient plus puissante, rapide et facile à diffuser.

La dynamique des plateformes numériques

Les réseaux sociaux jouent un rôle majeur dans la propagation de la désinformation. Sur des plateformes comme X (anciennement Twitter) ou Meta, la modération a nettement diminué, ce qui enferme les utilisateurs dans des « chambres d’écho ». Dans ces espaces, ils ne voient que des contenus qui confirment leurs idées, renforçant ainsi la polarisation et les divisions.

Les algorithmes de recommandation aggravent ce phénomène en favorisant les contenus qui provoquent de fortes réactions émotionnelles, qu’elles soient positives ou négatives. Comme le souligne Mathieu Colin, « les contenus liés à la droite sont mis en avant par les algorithmes » parce qu’ils « génèrent plus d’engagement ». Cette dynamique complique la tâche du public pour distinguer les informations fiables des récits trompeurs.

Crise de confiance envers les médias

La confiance des Canadiens envers les médias traditionnels est en forte baisse. Selon le rapport 2023 de l’Institut Reuters, seulement 40 % des citoyens leur font encore confiance, contre 60 à 65 % il y a 20 ans. Cette chute est meurtrière pour le secteur médiatique, car elle pousse le public à s’informer auprès de sources moins fiables. Martine Turenne souligne que cette méfiance amène les gens à placer sur un pied d’égalité des médias sérieux et des sites automatisés, souvent générés par l’intelligence artificielle.

Mathieu Colin ajoute que cette confusion brouille la frontière entre expert et amateur, rendant difficile la distinction entre informations fiables et récits alternatifs. La situation a été aggravée par la loi C-18, responsable du blocage des liens d’actualité sur certaines plateformes comme Meta. Chloé-Anne Touma déplore que, depuis cette mesure, « la nouvelle vérifiée n’est plus une priorité sur ces plateformes », ouvrant la porte à une propagation plus libre de la désinformation. Certains petits médias, privés de visibilité en ligne, ont même dû fermer leurs portes.

Fracture numérique et vulnérabilité à la désinformation

Par ailleurs, certaines populations sont particulièrement vulnérables à la désinformation en raison d’une fracture numérique persistante. Nathalie de Marcellis-Warin, professeure à Polytechnique Montréal, chercheuse et présidente du CIRANO, rappelle qu’il est essentiel d’éduquer tous les publics, notamment les personnes moins scolarisés, afin qu’ils développent les outils nécessaires pour différencier les sources fiables des contenus douteux. Cette sensibilisation est indispensable pour limiter l’impact de la désinformation.

Les solutions pour contrer la désinformation

Face à ces défis, les experts s’entendent sur un point: il est encore possible d’agir. Plusieurs affirment que l’éducation est la première ligne de défense. Cela passe par le développement de l’esprit critique, la littératie numérique et une meilleure compréhension des algorithmes. Jennifer Irish, directrice du Laboratoire sur l’intégrité de l’information de l’Université d’Ottawa, encourage le public à s’éduquer, à questionner les contenus et à adopter une posture critique face à l’information. Nathalie de Marcellis-Warin souligne que cet esprit critique est essentiel pour distinguer ce qui est vrai de ce qui ne l’est pas. L’école joue aussi un rôle clé. Catherine Dupont Gagnon, conseillère en sensibilisation et formatrice chez Cyber Citoyen, parle d’intégrer des cours de pensée critique, même si cela représente un défi pour les enseignants. Enfin, elle insiste sur l’importance de l’empathie dans l’espace public. Selon elle, cette capacité se développe, et le storytelling (la mise en récit) peut aider à reconnecter les faits aux émotions, tout en ramenant de la nuance dans un débat souvent polarisé.

Mais l’éducation seule ne suffit pas. D’autres solutions complémentaires existent. Sur le plan technologique, des experts rappellent que l’intelligence artificielle peut aussi être un outil de défense. « L’IA est à la fois un problème et une solution potentielle », affirme Jennifer Irish. Elle peut autant produire des images trompeuses qu’aider à les détecter. Marc Lalonde, spécialiste en vision par ordinateur au CRIM, parle d’une « course du chat et de la souris » entre créateurs de désinformation et outils de vérification. Gilles Boulianne souligne d’ailleurs que, pour l’instant, « le côté détection est en avance » sur les systèmes de synthèse vocale. D’autres appellent à investir massivement dans la diffusion de savoir scientifique. Pour Thierry Warin, cela devrait être « la première défense ». Il propose d’utiliser l’IA pour traduire et diffuser en ligne des connaissances déjà financées, dans plusieurs langues, pour contrer les récits trompeurs. Enfin, restaurer la confiance envers les institutions demeure essentiel.

La lutte contre la désinformation est un défi important, mais des solutions concrètes sont à notre portée. En renforçant l’éducation, en diffusant largement le savoir scientifique et en utilisant les technologies de façon responsable, nous pouvons construire une société mieux outillée pour faire face aux fausses informations. C’est un effort collectif, où chaque personne a un rôle à jouer pour préserver la qualité et la fiabilité de l’information.